MR4MR: Mixed Reality for Melody Reincarnation

ミュージック・コンクレートやアンビエント・ミュージックなど、私たちの身の回りにある実体や空間から音楽的要素を探求する試みには長い歴史があります。 コンピュータ音楽やデジタルアートの文脈でも、周囲の物体や物理的空間に焦点を当てたインタラクティブな体験がデザインされてきました。近年では、デバイスの開発と普及に伴い、そのような音楽体験を創出するためにXR(Extended Reality)でデザインされた作品が増えています。

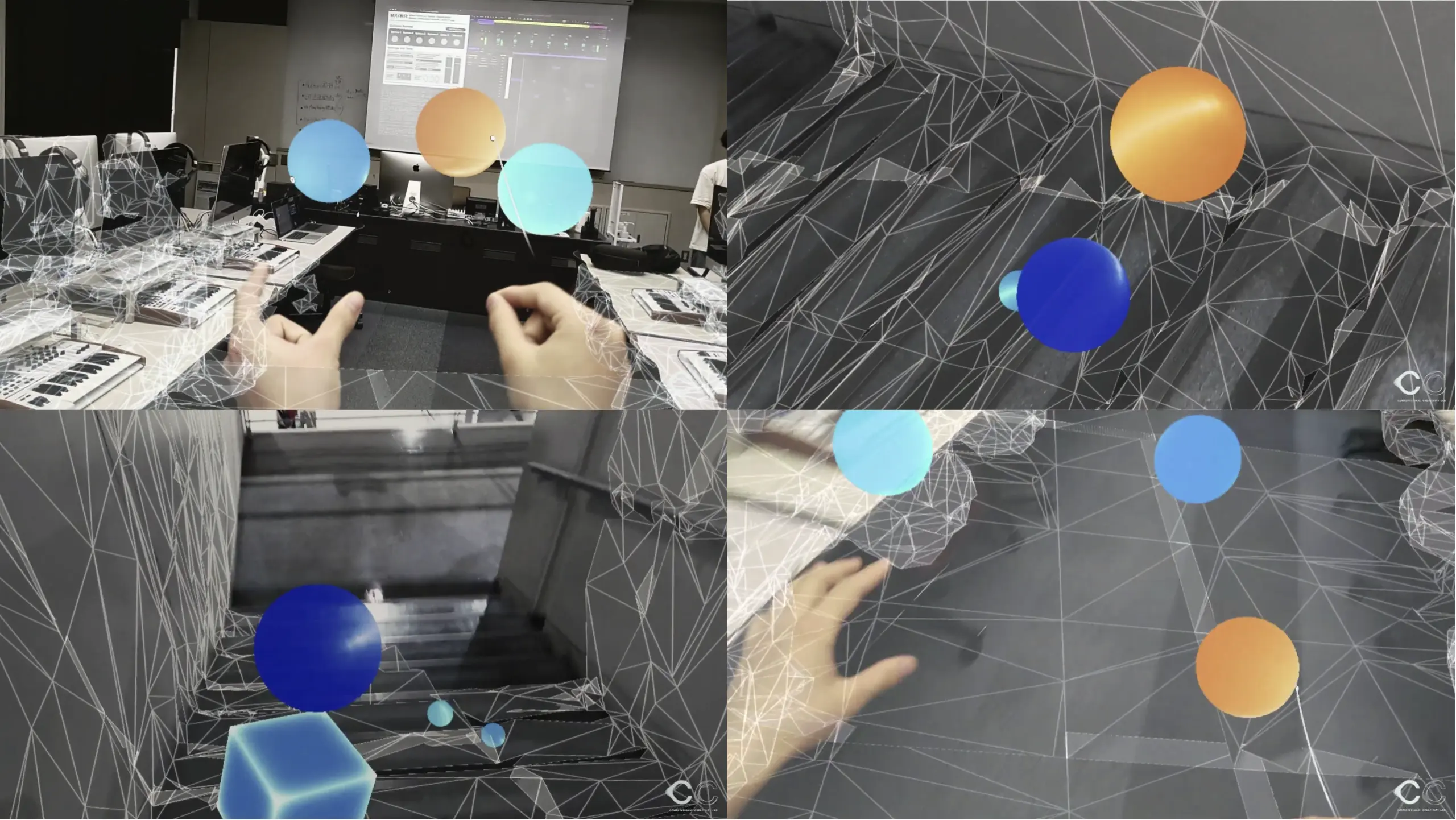

「MR4MR」は,周囲の空間とのインタラクションから生み出されるメロディを体験できるサウンドインスタレーション作品です。

ユーザーはMRヘッドマウントディスプレイであるHoloLensを使用し、音を発する仮想オブジェクトを周囲の現実のオブジェクトにぶつけることができます。

そして、オブジェクトが発した音に続くメロディを継続的に作成し、音楽生成機械学習モデルを用いてランダムかつ徐々に変化するメロディを再生成することで、ユーザーは周囲のメロディが「輪廻転生(reincarnating)」していくのを感じることができます。

展示

この作品はNTTインターコミュニケーション・センターで展示されました。

開発

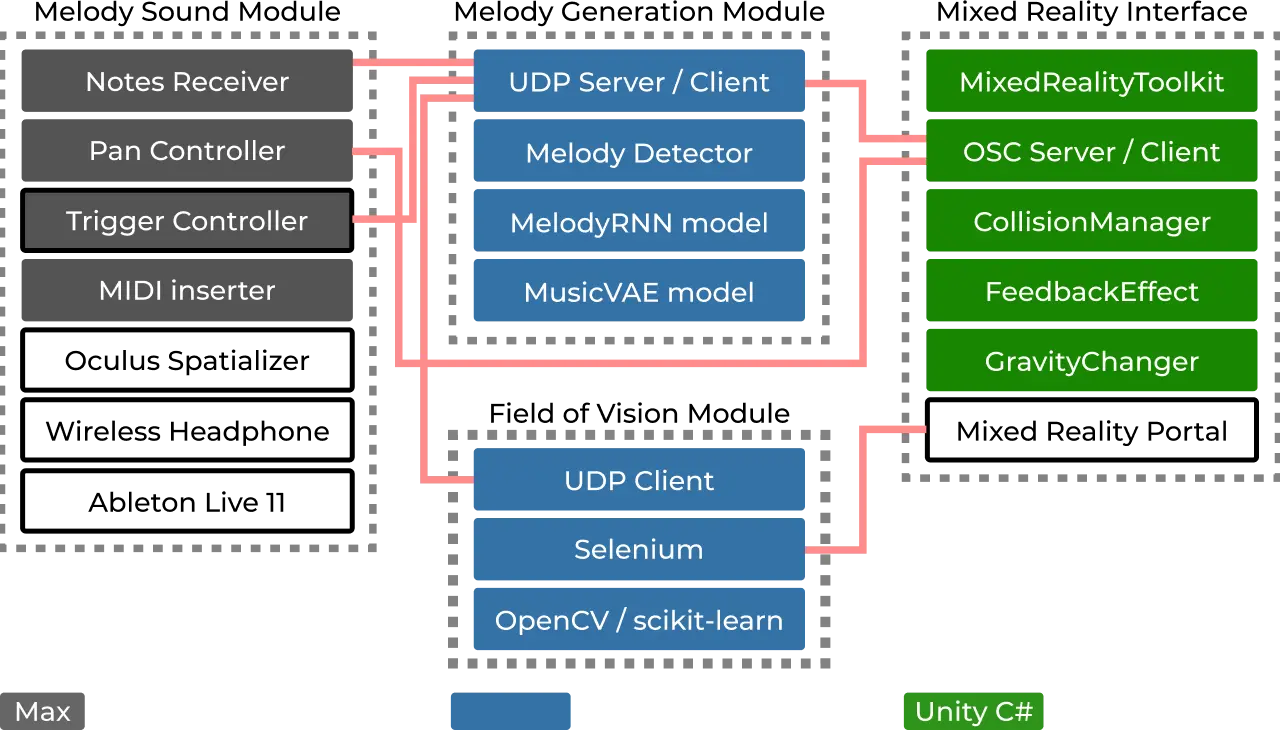

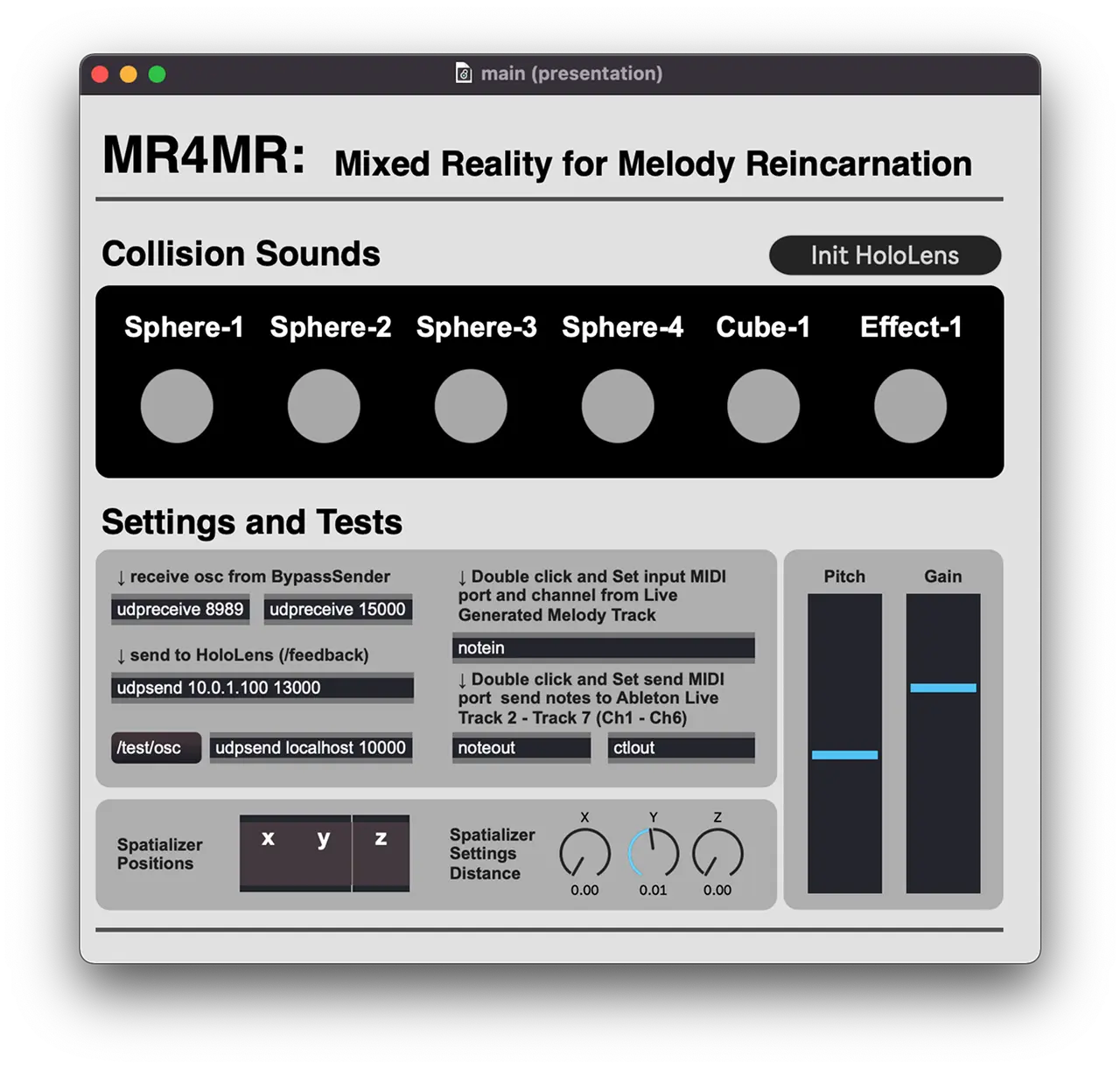

Ableton Live の Max 4 Live デバイスに組み込まれたMaxパッチとメロディ生成バックエンドのPythonプロセス,Hololans上のアプリケーションはそれぞれ同一ネットワーク内でOoen Sound Controlによる連携・RPCを行っています。

また,インスタレーション運用のためのユーザインタフェースの開発も行っています。

論文

AIMC (3rd Conference on AI Music Creativity 2022) のデモペーパーとして発表しています。

引用の際はこちらをご利用ください。

Kobayashi, Atsuya, Ishino, Ryogo, Nobusue, Ryuku, Inoue, Takumi, Okazaki, Keisuke, Sawa, Shoma, & Tokui, Nao. (2022, September 17). MR4MR: Mixed Reality for Melody Reincarnation. Proceedings of the 3rd Conference on AI Music Creativity. The 3rd Conference on AI Music Creativity (AIMC 2022). https://doi.org/10.5281/zenodo.7088357

Bibtex

@inproceedings{kobayashi_mr4mr2022, title = {MR4MR: Mixed Reality for Melody Reincarnation}, author = { Kobayashi, Atsuya and Ishino, Ryogo and Nobusue, Ryuku and Inoue, Takumi and Okazaki, Keisuke and Sawa, Shoma and Tokui, Nao }, year = 2022, month = {Sep}, booktitle = {Proceedings of the 3rd Conference on AI Music Creativity}, publisher = {AIMC}, doi = {10.5281/zenodo.7088357}, abstractnote = { There is a long history of an effort made to explore musical elements with the entities and spaces around us, such as musique concrète and ambient music. In the context of computer music and digital art, interactive experiences that concentrate on the surrounding objects and physical spaces have also been designed. In recent years, with the development and popularization of devices, an increasing number of works have been designed in Extended Reality to create such musical experiences. In this paper, we describe MR4MR, a sound installation work that allows users to experience melodies produced from interactions with their surrounding space in the context of Mixed Reality (MR). Using HoloLens, an MR head-mounted display, users can bump virtual objects that emit sound against real objects in their surroundings. Then, by continuously creating a melody following the sound made by the object and re-generating randomly and gradually changing melody using music generation machine learning models, users can feel their ambient melody "reincarnating" } }